1.安装方法一

首先进入到ollama的官网,地址如下:

https://ollama.com/点击页面中的Download按钮。

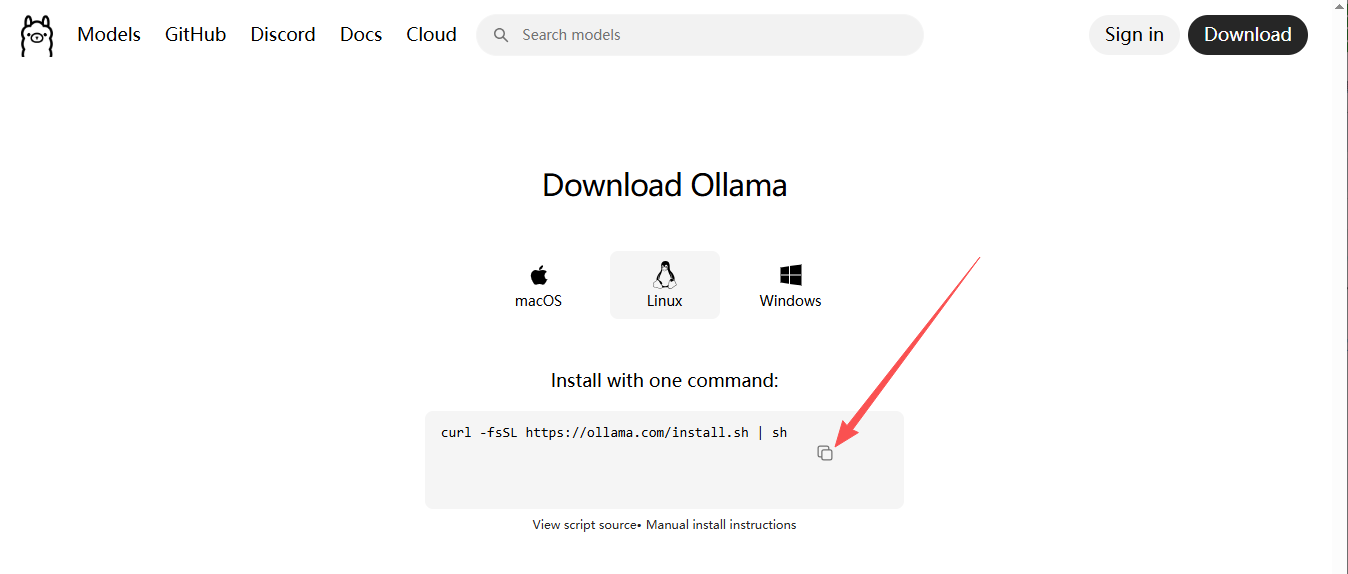

点击拷贝图中的安装命令,在Linux下粘贴执行:

curl -fsSL https://ollama.com/install.sh | sh

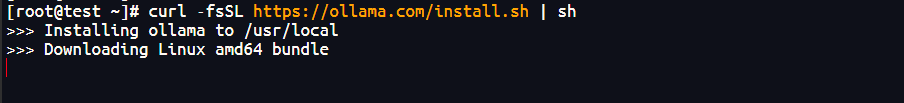

结果如下:

但此方法安装很缓慢,很久没有进度。

2.安装方法二

2.1 安装软件

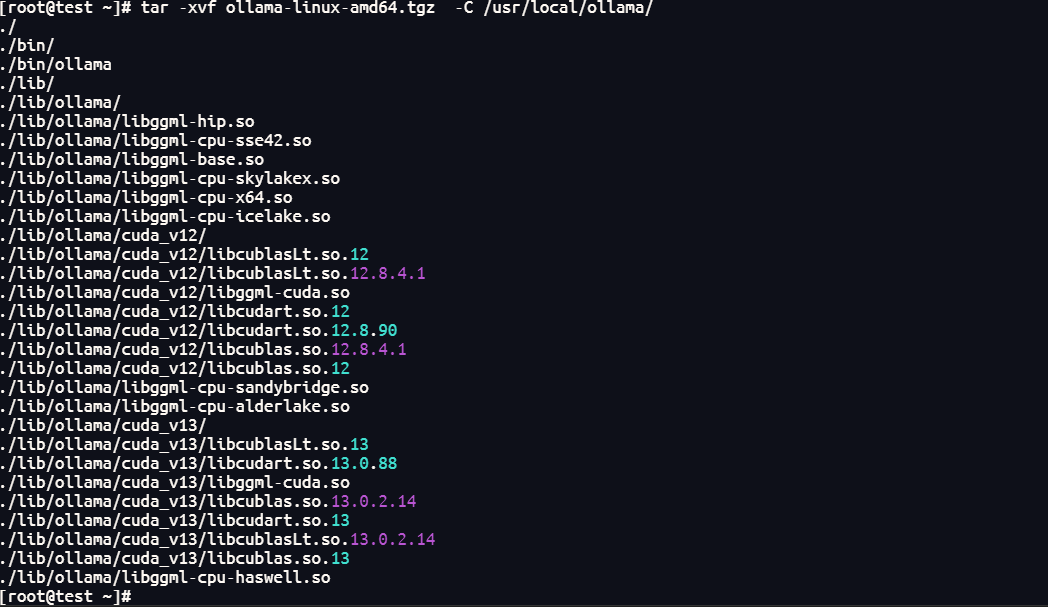

使用以下安装命令,手动安装二进制文件:

# 下载软件包

curl -L https://ollama.com/download/ollama-linux-amd64.tgz -o ollama-linux-amd64.tgz

# 解压软件

tar -xvf ollama-linux-amd64.tgz -C /usr/

# 查看版本

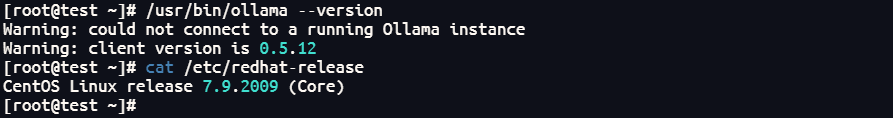

ollama --version

如果最后有版本显示,则安装成功,也可以从github上下载到最新的ollama各版本的下载文件,地址如下:

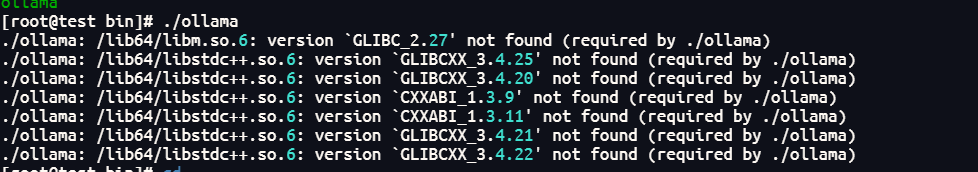

https://github.com/ollama/ollama/releases如果操作系统内核较低,出现以下问题,可以降低版本。

比如我的CentOS 最终下载了0.5.12版本,可以正常启动。其它版本的系统的版本如果发现不兼容,也可以用同样的方式解决。

2.2 安装服务

创建一个存放模型的目录:

# 比如我这里的目录 /home/ollama/models

mkdir -p /home/ollama/models创建ollama用户:

groupadd ollama

useradd -s /sbin/nologin ollama用ollama为模型目录赋予权限:

sudo chown -R ollama:ollama /home/ollama

sudo chmod -R 777 /home/ollama/models/创建启动文件

# 创建一个启动文件

touch /etc/systemd/system/ollama.service 把下面的内容粘贴进去,将其中的OLLAMA_MODELS改为实际的model路径。 vim /etc/systemd/system/ollama.service

[Unit]

Description=Ollama Service

After=network-online.target

[Service]

ExecStart=/usr/bin/ollama serve

User=ollama

Group=ollama

Restart=always

RestartSec=3

Environment="PATH=$PATH"

Environment="OLLAMA_MODELS=/home/ollama/models"

[Install]

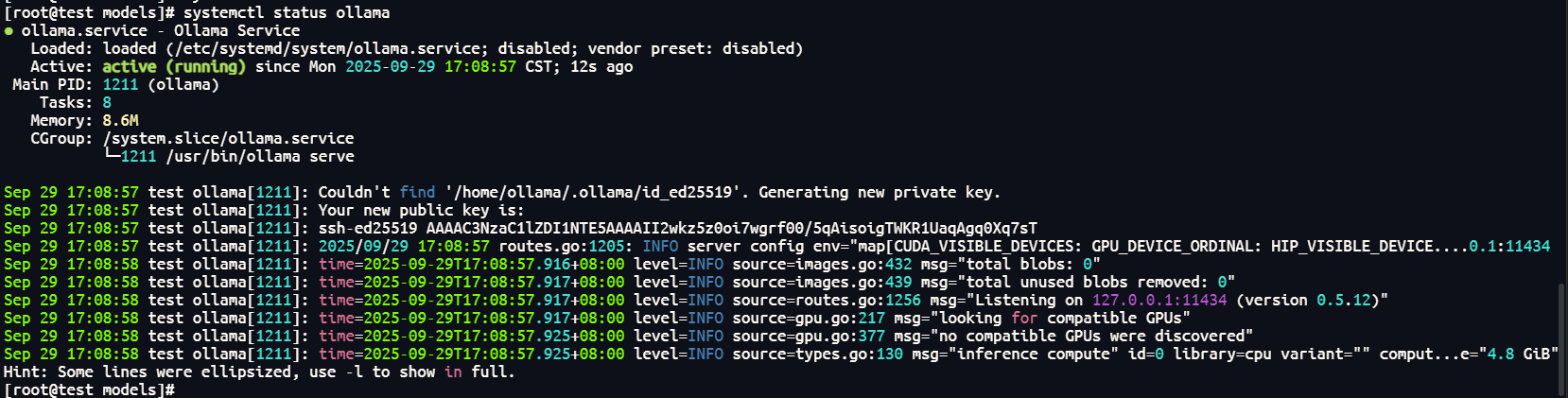

WantedBy=multi-user.target保存启动:

sudo systemctl daemon-reload

sudo systemctl restart ollama

sudo systemctl status

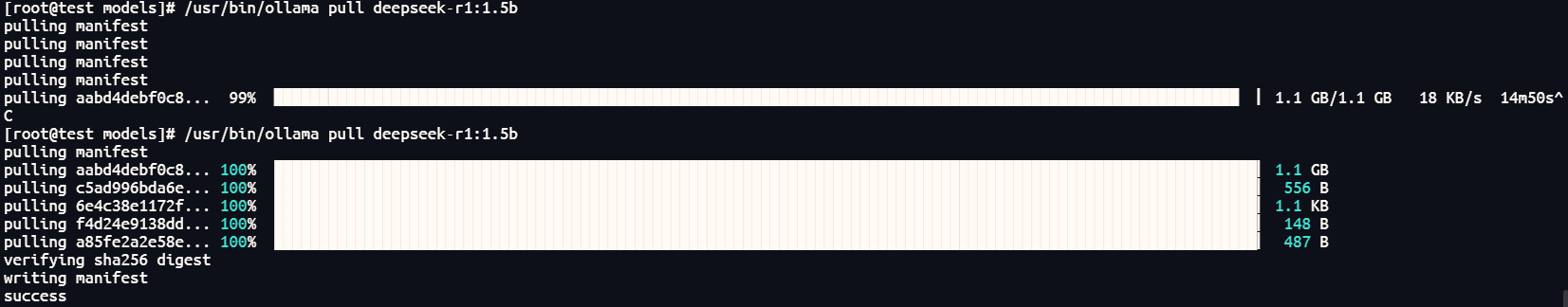

正常拉取模型:

/usr/bin/ollama pull deepseek-r1:1.5b 正常运行模型:

正常运行模型:

/usr/bin/ollama run deepseek-r1:1.5b

评论区